摘要

逆转录聚合酶链反应是目前COVID-19诊断的金标准。然而,它可能需要几天的时间来提供诊断,假阴性率相对较高。影像学,特别是胸部计算机断层扫描(CT),可以帮助诊断和评估这种疾病。然而,研究表明,标准剂量CT扫描给患者带来了巨大的辐射负担,特别是需要多次扫描的患者。在本研究中,我们考虑低剂量和超低剂量(LDCT和ULDCT)扫描方案,将辐射暴露降低到接近单一x射线的水平,同时保持可接受的诊断分辨率。由于胸部放射学专业知识在大流行期间可能无法广泛获得,我们使用收集的LDCT/ULDCT扫描数据集开发了一个基于人工智能(AI)的框架,以研究AI模型可以提供人类水平表现的假设。人工智能模型采用两阶段胶囊网络架构,可通过LDCT/ULDCT扫描快速对COVID-19、社区获得性肺炎(CAP)和正常病例进行分类。基于交叉验证,人工智能模型对COVID-19的敏感性达到\(89.5下午\ % \ 0.11 \), CAP灵敏度\ (95 \ % \ pm 0.11 \),正常病例的敏感性(特异性)\(85.7下午\ % \ 0.16 \),以及\ (90 \ % \ pm 0.06 \).通过纳入临床数据(人口统计学和症状),性能进一步提高了对COVID-19的敏感性\(94.3下午\ % \ 0.05 \), CAP灵敏度\(96.7下午\ % \ 0.07 \),正常病例的敏感性(特异性)\ (91 \ % \ pm 0.09 \),以及\(94.1下午\ % \ 0.03 \).所提出的AI模型基于LDCT/ULDCT扫描,减少了辐射暴露,实现了人类水平的诊断。我们认为,提出的人工智能模型有可能帮助放射科医生准确、及时地诊断COVID-19感染,并帮助控制大流行期间的传播链。

简介

自2019年12月中国武汉爆发冠状病毒病(COVID-19)以来,一场全球医疗危机已经出现1.实时逆转录聚合酶链反应(RT-PCR)目前被认为是新冠肺炎诊断的金标准方法。但RT-PCR方法存在许多局限性,除了耗时外,在不同临床样本中假阴性率较高2.胸部计算机断层扫描(CT)由于其高灵敏度和快速获取,已成为COVID-19诊断、预后评估和发现并发症的主要成像方式3.,4,5.COVID-19肺炎胸部CT最常见表现为多灶性磨玻璃影(GGO),伴或不伴实变区,主要分布于外周、下叶和后部解剖区4,5.CT扫描有助于评估并发症、COVID-19受累程度和重症监护病房(ICU)入院风险。

在疫情期间广泛使用CT扫描作为疑似患者筛查工具的主要担忧是辐射暴露。在某些情况下,症状严重的患者在病程中需要进行多次胸部CT扫描。这些多次照射的累积效应可显著增加辐射剂量。研究6胸部CT扫描时对身体器官的投影辐射在甲状腺、肺、乳房和食道最高。由于她们更长的寿命,更高的剂量有效的乳腺组织和细胞增殖7,8在美国,儿童和年轻妇女更容易受到辐射照射损伤,患辐射后恶性肿瘤的风险增加。尽可能低(ALARA)9规则规定,当预期辐射时,暴露应保持在可达到的最低水平,以便最终扫描仍能提供合理的分辨率。

低剂量和超低剂量CT扫描(LDCT和ULDCT)在发现和随访肺结节和其他肺部病变方面的诊断准确性已经得到了证实10.与标准胸部CT相关的辐射剂量估计为7 mSv, LDCT方法降低到1-1.5 mSv, ULDCT方法低至0.3 mSv。低剂量方案的优点是辐射剂量减少80%以上。最近的研究11研究表明,在接受标准剂量CT扫描的患者中,DNA双链断裂和染色体损伤增加,而在接受低剂量CT扫描的患者中,对人类DNA没有影响。LDCT和ULDCT在肺炎患者的GGOs和实变检测中显示出显著的准确性12.由于GGO和实变是COVID-19最常见的CT表现,最近建议用LDCT和ULDCT取代标准CT扫描13作为减少COVID-19患者辐射暴露的解决方案。在一个回顾性研究中14LDCT迭代重建(IR)对COVID-19诊断的敏感性、特异性、阳性预测值、阴性预测值及准确率均在90%左右。结合其他临床发现,LDCT和ULDCT有可能取代标准剂量,用于评估患者,特别是孕妇和年轻女性,以及儿科人群,以减少辐射暴露15.

尽管快速发现COVID-19阳性病例至关重要,但医生和卫生保健人员仍无法应对需要立即护理和治疗的患者人数不断增加。换句话说,胸科放射科专家可能无法在任何时候及时诊断阳性病例,不仅导致治疗延误,而且没有及时隔离的患者还会进一步传播病毒。最近的研究16,17已经证明了人工智能(AI)模型在LDCT肺结节检测方面达到人类水平的能力。基于此,本研究旨在开发一个基于深度学习架构的人工智能模型,利用LDCT和ULDCT区分COVID-19与社区获得性肺炎(CAP)和正常病例。据我们所知,参考书18是唯一一项在基于人工智能的COVID-19分析中考虑LDCT的研究,通过模拟低剂量扫描的标准剂量扫描。然而,上述研究使用的是合成数据,即没有使用来自COVID-19个体的真实LDCT/ULDCT数据,也没有涉及疾病诊断,这是我们研究的主要重点。我们假设,基于LDCT和ULDCT扫描,人工智能在诊断COVID-19方面可以达到人类水平。

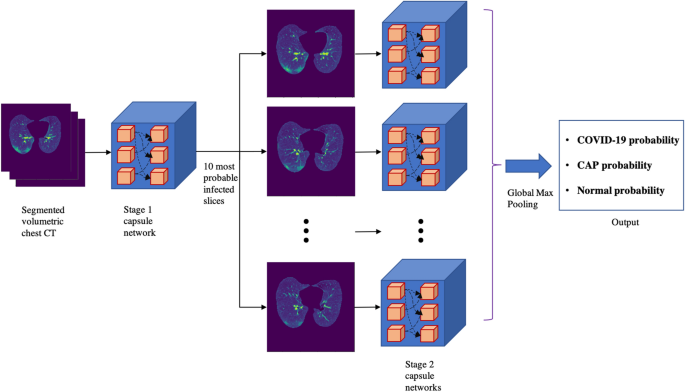

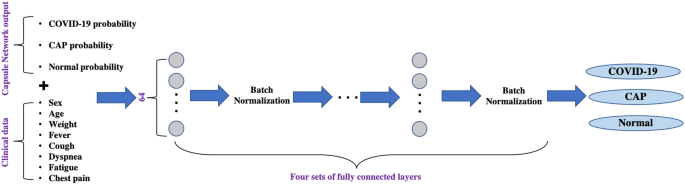

我们开发了一个两阶段深度学习模型,如图所示。1,建立在胶囊网络架构上19,20.,以肺节段区为输入。该模型的第一阶段是一个胶囊网络,负责检测有感染证据的切片(由COVID-19或CAP引起)。在之前的研究之后21, 10个最可能感染的切片,以及它们的感染概率,作为第二阶段的输入,该阶段并行分析所有候选,通过汇总每个候选的结果来做出决策。最终输出是代表COVID-19、CAP或正常类别的基本病例的概率。第一阶段模型是在有经验的放射科医生提供的切片级标签上训练的,第二阶段是在患者级标签上训练的。扩展所提出的深度学习模型,我们加入临床数据,即深度学习模型的输出与临床数据合并并馈给多层感知器(MLP),如图所示。2,以作出最终诊断。

结果

我们收集了104例COVID-19阳性病例和56例正常病例的LDCT和ULDCT扫描数据集,这些数据集于2020年10月、2020年12月和2021年1月收集于伊朗德黑兰Babak成像中心。RT-PCR检测确诊38例(36.5%)。其余部分由3位经验丰富的胸科放射科医生(M.J.R、f.b.f.和A.O.)的共识确定,他们通过考虑影像学表现、临床特征(症状和病史)和流行病学来标记数据集。三位放射科医生达成了95.6%的一致意见。他们还根据肺部受累的百分比将COVID-19病例的严重程度评分为1至4。4例COVID-19阳性病例未显示任何相关影像学表现。由于我们无法获得CAP患者的LDCT扫描,因此我们将该数据集与60个标准剂量容量CT扫描相结合22.因此,我们最终共有220名患者。数据集特征如表所示1.P-值是通过logistic回归得到的,考虑了COVID-19与CAP和正常、CAP与COVID-19与正常、正常与COVID-19和CAP三种二元情景。为了便于获取,这里我们翻译了表的第一行:“58.6%的COVID-19患者是男性,58%的CAP病例是男性,39.3%的正常病例是男性,性别有一个。P-value为0.7386,在区分COVID-19与其他两类时,具有P将CAP与其他两类区分时,-value为0.1848P区分normal和其他两个class时,-value为0.0314”。最后,第四位经验丰富的胸科放射科医生(R.A.)对地面真相一无所知,他标记了收集的数据集,以将AI模型的性能与人类专家进行比较。放射科医生首先得到的是CT扫描结果,然后是临床数据。

为了减少对特定测试集的偏差,我们采用了10倍交叉验证方法来评估放射科医生和AI模型的性能,基于仅使用CT扫描的两种场景,并结合临床数据。数据集随机分为10个大小相等的测试集,每个测试集10个,包括22个案例。我们确保每个测试集包含10%的COVID-19、CAP和正常病例,每个测试集包含10或11例COVID-19、6例CAP和5或6例正常病例。AI模型被训练了10次,将其中一个测试集放在一边,并使用其余的测试集进行训练。平均超过10次折叠,第一阶段的切片级分类器的精度达到\ (89.88 \ % \),敏感度\ (88.24 \ % \),以及\ (92.01 \ % \),以检测感染切片。

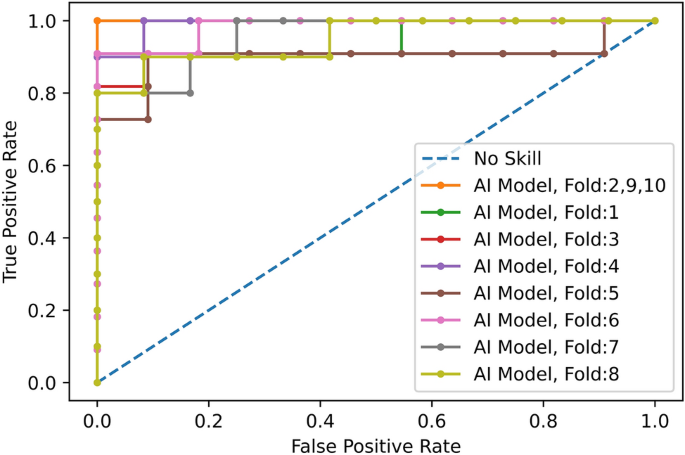

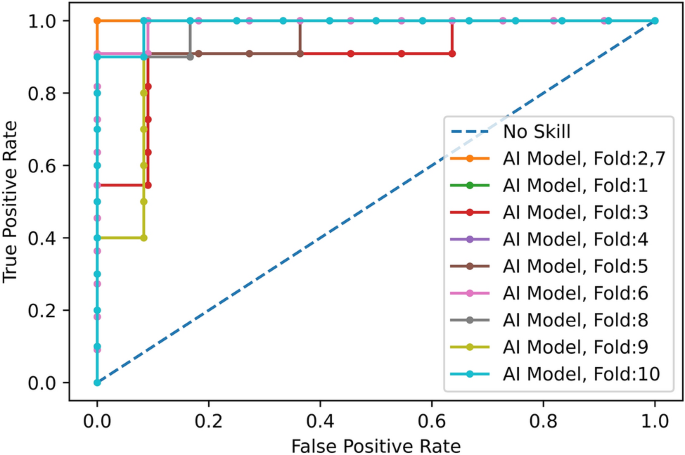

仅使用CT扫描,我们评估了所开发的深度学习模型,并将其与第四位胸科放射科医生进行了比较,如表所示2.平均所有10倍,AI模型达到COVID-19的敏感性\(89.5下午\ % \ 0.11 \), CAP灵敏度\ (95 \ % \ pm 0.11 \)的正常敏感性(特异性)\(85.7下午\ % \ 0.16 \),以及\ (90 \ % \ pm 0.06 \).另一方面,放射科医生对COVID-19的敏感性达到\(89.4下午\ % \ 0.12 \), CAP灵敏度\(88.33下午\ % \ 0.11 \)的正常敏感性(特异性)\ \ (100 \ %),以及\(91.8下午\ % \ 0.07 \).我们使用McNemar测试了人工智能模型和放射科医生在准确性方面具有相同性能的假设23检验显著性水平为0.05,导致所有10次折叠的p值均超过显著性水平。人工智能模型的低特异性符合COVID-19的非特异性发现24.在受试者工作特征(ROC)曲线中绘制了COVID-19敏感性与1 -特异性的关系,如图所示。3..曲线下面积(AUC)\(0.96下午\ 0.03 \).

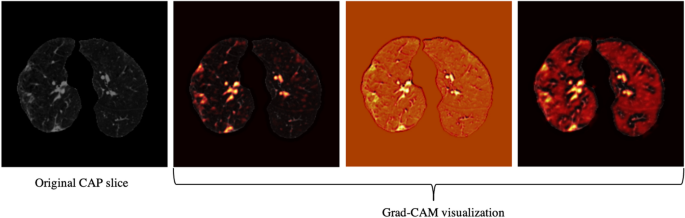

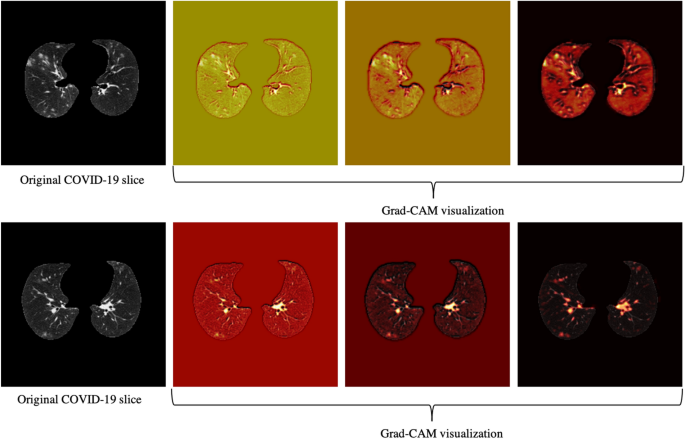

仅在CT扫描的基础上,我们对11例误分的COVID-19病例进行了全褶皱分析,并研究了其与病情严重程度的关系,得出11例中4例没有任何相关影像学表现,5例被三位放射科医生评分为1分,1例评分为2分,只有1例评分为3分,这意味着所开发的模型对重症病例的误分可能性较小。开发的模型和经验丰富的放射科医生都无法在仅使用CT扫描而没有影像学发现的情况下检测出4例COVID-19病例。此外,由于CAP患者来自不同的队列,并使用标准剂量进行扫描,我们将CAP病例的模型输出可视化,其中一个如图所示。4,采用Grad-CAM定位技术。该图显示,该模型更关注图像中与疾病相关的区域,而不是与剂量相关的区域。我们对感染相同COVID-19患者的两片切片进行了相同的定位技术,如图所示。5.

使用CT扫描和临床数据,我们评估了开发的深度学习模型,并将其与放射科医生进行了比较,如表所示3..平均所有10倍,AI模型达到COVID-19的敏感性\(94.3下午\ % \ 0.05 \), CAP灵敏度\(96.7下午\ % \ 0.07 \)的正常敏感性(特异性)\ (91 \ % \ pm 0.09 \),以及\(94.1下午\ % \ 0.03 \).另一方面,放射科医生对COVID-19的敏感性达到\(94.4下午\ % \ 0.05 \), CAP灵敏度\(93.3下午\ % \ 0.08 \)的正常敏感性(特异性)\ \ (100 \ %),以及\(95.4下午\ % \ 0.03 \).我们测试了AI模型和放射科医生具有相同性能的假设,使用LDCT和临床数据,就准确性而言,导致p值超过所有10倍的显著性水平。在受试者工作特征(ROC)曲线中绘制了COVID-19敏感性与1 -特异性的关系,如图所示。6.曲线下面积(AUC)\(0.96下午\ 0.03 \).

我们结合CT扫描和临床资料,对6例误分的COVID-19病例进行了全折叠分析,并研究了其与病情严重程度的关系,6例中有3例没有任何相关影像学表现,1例被三位放射科医生评分为1分,2例评分为3分。结合临床数据,人工智能模型可以在没有相关影像学发现的情况下,检测出四例COVID-19阳性病例中的一例,而放射科医生没有检测到任何一例。

最后,我们将开发的AI模型纳入ldct和临床数据,在额外的100例COVID-19阳性患者上进行了测试,这些患者的诊断通过RT-PCR测试得到确认,并在不同的时间间隔(窄验证)收集。这些患者不包括在任何10个折叠和完全看不见的模型和放射科医生。100例中有68例有影像学表现,32例没有任何相关表现。男性占总病例的53%,平均年龄46.16岁,标准差14.07。人工智能模型正确地识别了所有68个有影像学发现的阳性病例,而它只检测出其中3个没有相关发现的阳性病例。另一方面,放射科医生在68例有影像学表现的患者中正确地将64例归类为COVID-19,并将4例归类为CAP。没有影像学表现的病例都没有被放射科医生识别出来。AI模型与放射科医生灵敏度之间的p值为0.01。

讨论

虽然LDCT和ULDCT可以揭示COVID-19相关的结果,并减少潜在的辐射相关危害,但准确的诊断需要放射科医生的全面调查,这在疫情期间可能是不可能的。基于我们的实验,提出的基于胶囊网络的AI模型有潜力快速区分COVID-19病例与CAP和正常病例,使用LDCT和ULDCT具有人类水平的表现,具有单一x射线图像的辐射剂量。换句话说,开发的人工智能系统可以在最低限度的辐射下协助放射科医生,并有助于控制COVID-19传播链。

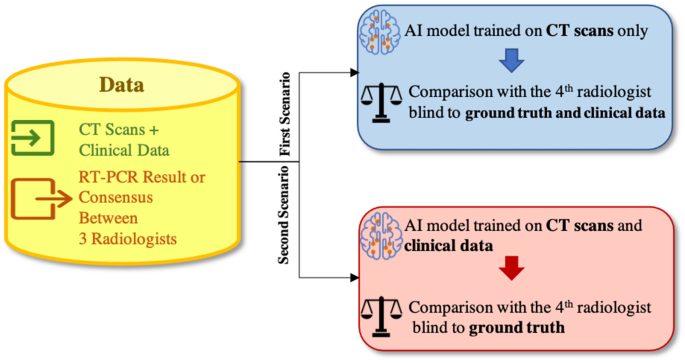

为了验证所提出的AI模型,我们考虑了两种场景,如图所示。7.在第一种情况下,人工智能模型只提供图像,并与不了解实际情况和临床数据的放射科医生进行比较。虽然这种策略不符合常规的临床实践,但目的是在不结合临床数据的情况下研究图像的诊断潜力。在第二种场景中,图像和临床数据都被输入到AI模型中,相应的,AI模型将与仅对地面真相视而不见的放射科医生进行比较。我们发现,通过纳入临床数据,COVID-19的敏感性提高了4.8%,CAP的敏感性提高了1.7%,正常的敏感性和准确性分别提高了5.3%和4.1%。

值得注意的是,虽然纳入的CAP病例是从不同队列中提取的,但其动机是研究AI模型区分COVID-19与CAP的能力,因为这两者的胸部CT结果重叠25.CAP病例使用标准剂量CT筛查而不是LDCT和ULDCT,这一事实可以被认为是我们研究的一个局限性,因为低剂量筛查与较低的检测能力相关26.然而,构建使用不同辐射剂量获得的CT扫描数据集是一种常见的做法27,以便开发在更大数据集上通用的模型。此外,虽然我们的COVID-19和正常病例都是用LDCT或ULDCT扫描的,但后者的图像质量可以通过重建技术进行平衡28.

我们的研究还有其他一些局限性。首先,数据集是从单个中心收集的,需要进行实验来验证其在外部机构数据上的性能,因为研究模型是否适用于不同的人群是至关重要的29,30..易受数据变化影响,对代表性不足的人群存在偏见29在人工智能模型投入实践之前,也必须解决这些问题。值得一提的是,由于额外的100名COVID-19阳性患者是在与原始集不相交的时间间隔内收集的,因此可以作为狭窄验证30..然而,它是从同一研究所收集的,因此不能说明广泛的验证。对COVID-19诊断的域验证也很感兴趣,其中测试集来自不同的变体。第二,样本量相对较小。验证模型在更大的多中心数据集上的性能是我们即将进行的研究的目标。与传统模型相比,我们研究中使用的胶囊网络能够处理小型数据集,由于可训练参数较少,它不太容易过度拟合,然而,较大的数据集仍然可以提高模型的性能。我们还旨在扩展所提出的AI模型,以预测除了诊断之外的疾病严重程度。此外,尽管如图所示。4而且5人工智能模型输出的可视化显示,它正在关注相关区域,需要更多的研究来提高其可解释性。在没有影像学发现的COVID-19病例中表现不佳是已开发模型的另一个局限性。

总之,我们认为开发的AI模型通过结合LDCT/ULDCT和临床数据达到了人类水平的表现,具有降低辐射暴露相关风险的优势。该模型可作为放射科医生的决策支持系统,并有助于控制传播链。由于我们开发的人工智能模型不打算成为主要诊断工具,我们的目标是与胸科放射科医生一起测试模型,以评估其作为决策支持工具而不是独立系统的性能。

方法

本研究遵循加拿大蒙特利尔康科迪亚大学批准的医疗数据二次使用伦理可接受性政策认证编号30013394进行。获得所有患者的知情同意。

LDCT / ULDCT数据集

LDCT/ULDCT数据集包括2020年10月、12月和2021年1月在伊朗德黑兰Babak成像中心收集的104例COVID-19阳性病例和56例健康病例的低剂量胸部CT扫描,其中36.5%(38例)的COVID-19病例RT-PCR阳性。其余病例的诊断是由三位经验丰富的放射科医生(M.J.R, f.b.f.和A.O.)达成一致意见,95.6%一致。三位放射科医生在标记数据集时考虑了以下三个主要标准:

影像学表现包括GGOs、实变模式、疯狂铺张、双侧及多灶性肺受累、周围分布、下叶优势;

临床表现,包括症状和病史;

流行病学

确诊的COVID-19病例的CT切片由首批放射科医生标记是否有感染证据。此外,所有三位放射科医生都对COVID-19病例的严重程度进行了评分,将1到4之间的数字进行了划分,1为轻症,4为重症。最终的严重程度评分是三个放射科医生评分的平均值,四舍五入到最接近的整数。严重程度是根据肺部受累的百分比来确定的,具体如下:

1: 1 - 24%

2: 25 - 49%

3: 50 - 74%

4:\通用电气(\ \)75%

男性和女性病例分别占LDCT数据集的52%和48%,最低年龄为14岁,最高年龄为78岁。男性主导在许多COVID-19数据集中很常见31部分原因是男性更容易感染COVID-1932.此外,性别与CT表现无相关性33.值得一提的是,为了遵守DICOM补充142(临床试验去识别配置文件)34,我们已经去识别了所有的CT研究。

容积性LDCT和ULDCT扫描由SIEMENS SOMATOM Scope扫描仪获得。所有扫描均在轴向视图中并重建为512 \ \ 512 \倍)图像使用过滤后投影方法35.标准胸部CT扫描的辐射剂量估计为7毫西弗在LDCT扫描中降低到1-1.5 mSv,在ULDCT扫描中降低到0.3 mSv。适用于患有\ (> 60 \)LDCT图像的获取采用mAs值为20,kVp为110 v,切片厚度为2mm,而对于体重小于60 kg的患者,ULDCT图像的获取采用15mas。

由于我们无法获得CAP病例的LDCT/ULDCT,我们使用了一组60例患者的标准剂量容量胸部CT扫描22,在2018年4月至2019年12月大流行开始前收集。本组男性35例,女性25例,平均年龄57.7岁,标准差21.7。第一个放射科医生还对CAP组切片进行分析,以确定有感染证据的切片。使用SIEMENS SOMATOM Scope扫描仪,使用94-500 mA的管电流,110-120 v的kVp, 2 mm的切片厚度获取CAP图像。

如表所示1,所有病例均伴有人口统计学和临床资料,即性别、年龄、体重,有无咳嗽、发热、呼吸困难、胸痛和疲劳5种症状。我们将所提出的AI模型的性能与第四位经验丰富的放射科医生(R.A.)进行了比较,后者对标签一无所知,首先仅通过CT扫描,然后结合临床数据,将标准剂量和LDCT/ULDCT分为COVID-19、CAP和正常。

我们还纳入了额外的100例RT-PCR阳性的COVID-19阳性患者。男性占总病例的53%,平均年龄46.16岁,标准差14.07。这套收藏于2021年4月。

数据预处理

我们使用预训练的基于u - net的肺分割模型36,称为“U-net (R231CovidWeb)”,用于分割肺区域并丢弃无关信息。该分割模型对COVID-19图像进行了微调,从而提高了其性能和对当前问题的可靠性。因此,所有图像都是从原始大小的512 \ \ 512 \倍)像素256 \ \ 256 \倍)像素。

两阶段深度学习模型

所提出的两阶段深度学习模型,如图所示。1,由两个连续的胶囊网络组成19,20.,在处理图像实例之间的空间关系方面优于常用的卷积神经网络(cnn)。分段胸部CT扫描是第一阶段的输入,该阶段识别带有感染证据的图像。有感染的切片可能与CAP或COVID-19患者有关。然后选择10个最有可能感染的切片作为第二阶段的输入,该阶段由时间分布的胶囊网络组成,指的是通过同一模型同时处理切片。在这个阶段,从各个切片生成的分类概率通过全局最大池化操作来做出最终决策。接下来,对这两个阶段进行更详细的解释。

第一阶段:胶囊网络

胶囊网络是一种相对较新的人工智能架构,旨在克服传统深度神经网络的一些关键缺点,并提供更多的信息特征。Capsule网络更丰富的特征表示的关键是使用向量(称为Capsule的神经元集合)而不是标量(单个神经元)。换句话说,“胶囊”是作为一个单元的神经元组,它的激活取决于输入中特定实体存在的概率。胶囊网络由这些胶囊层堆叠在一起组成一个深度神经网络,并从输入数据中学习判别特征。虽然传统的深度学习解决方案无法传达有关提取特征之间相对相关性的信息,但Capsule网络可以解决这个问题(通过其路由协议机制),并更好地建模网络内部现有的相关性。通过协议路由过程,较低层的胶囊尝试预测下一层胶囊的输出,并根据预测的正确性给出优先级。最后一层的胶囊向量的振幅表示输入图像属于特定目标类的概率。Capsule网络的另一个关键优势是它们能够用更少的可训练参数收集更详细的信息37.这反过来又导致在减少输入数据数量的情况下实现更好的性能,使其成为解决手头问题的理想AI模型。

所提出的人工智能框架的第一阶段负责在与患者对应的一系列CT图像中识别显示感染(由COVID-19或CAP引起)的切片。第一阶段将提供候选切片的子集,以便在下一阶段进行分析,下一阶段只关注疾病类型。为了训练第一阶段,我们使用2D CT图像及其对应的标签(传染性vs非传染性)来构建一个切片级分类器,其输出决定了输入图像属于特定目标类(传染性vs非传染性)的概率。然后我们为每个患者提取10个感染概率最高的切片作为第二阶段的输入。考虑到COVID-19疾病表现的特定特征,包括多灶性GGOs,主要分布在肺的外周、下叶和后叶解剖区,我们采用了基于胶囊网络的分类器,而不是传统的基于cnn的分类器。正如我们之前的研究所证明的20.,胶囊网络具有很强的捕捉空间关系的能力38与对应的数据集相比,使用较小的数据集和更少的参数,在医学图像中的组件之间进行比较,这在COVID-19疾病的情况下至关重要。

第一阶段的架构开始于由四个卷积层、一个池化层和一个批处理归一层组成的堆栈,通过两个快捷连接将浅层特征传递到模型的深层。这些层之后是三个胶囊层的堆栈,以生成最终输出,即输入图像属于相关目标类的概率。值得注意的是,在第一阶段,我们处理的是一个不平衡的数据集,有更多的切片,没有感染的证据。为了处理这个不平衡的数据集,我们在训练步骤中修改了损失函数,并考虑对显示感染的切片中的错误进行更高的惩罚。

阶段2:时间分布胶囊网络

所提出的人工智能框架的第二阶段是一个时间分布的胶囊网络,将前一阶段的10个候选作为输入。这些图像通过具有共享所有可训练权重的相同架构的胶囊网络并行处理。这些胶囊网络由三个卷积层、一个批处理归一化层和一个最大池化层组成。最后一个卷积层的输出被重塑以形成初级胶囊,然后通过两个胶囊层。每个候选的最后一层胶囊对应于COVID-19、CAP和正常的三种类型。为了考虑候选切片被感染的概率,将COVID-19和CAP类别乘以第一阶段产生的感染概率。普通类也乘以1减去感染概率。最后,对候选切片对应的胶囊网络的输出进行全局最大池化操作,从而做出最终决策。

我们使用Adam优化器训练第二阶段的时间分布胶囊网络,学习率为1e\ (^ {4} \),批大小为8,150个epoch。与第一阶段相似,我们使用修正的边际损失函数来考虑对少数群体的更多惩罚。边际损失是参考文献中介绍的胶囊网络的原始损失函数19.

结合临床资料

训练两阶段深度学习模型后,将三个类别(COVID-19、CAP、正常)的输出概率与8个临床数据(人口统计学和症状,即性别、年龄、体重以及是否存在咳嗽、发烧、呼吸困难、胸痛和疲劳5种症状)连接起来,馈入多层感知器(MLP)模型,如图所示。2.该模型有4个完全连接层,包含64个神经元,其中每一层都遵循批量归一化。最后一层包括3个具有“Softmax”激活函数的神经元。我们用交叉熵损失和Adam优化器训练MLP模型,学习速率为1e\ (^ {4} \),批大小为16,500个epoch。

Grad-CAM可视化

我们采用了Grad-CAM定位映射方法39以提供对中间层的深入洞察,并确定CT图像中的哪些组件得到了模型的最多关注。Grad-CAM方法提取空间信息,由卷积层保留,并指定图像中对最终预测贡献最大的部分。更具体地说,Grad-CAM方法生成对应于每一层和目标类的本地化热图,以确定模型最关注的位置。该定位热图是由卷积层中所有特征图的加权平均得到的,然后是一个整流线性单元(ReLU)激活函数。

统计分析

K-fold交叉验证40是一种统计方法,用于评估模型在未见数据集上的性能。根据这种方法,将原始数据集随机分割为K等量的样本,并通过K迭代的训练和测试,每一个K集用于测试,其余用于培训。该方法在本研究中用于评估AI模型的性能以及对标签不敏感的放射科医生,其中K设置为10。报告了每个折叠的性能,以及所有折叠的平均值和标准偏差。此外,在每个KFold,训练集的30%用于相关模型的验证,并据此选择最优模型并在测试集上进行测试。McNemar检验法23检验用于检验人类和AI模型具有相同性能的假设,显著性水平为0.05。采用Logistic回归方法对COVID-19与CAP与正常、CAP与COVID-19与正常、正常与COVID-19与CAP三种二元分类场景下临床因素的显著性进行评估。

代码的可用性

参考文献

中国2019冠状病毒病(covid-19)暴发的特征和重要教训:中国疾病预防控制中心72314例报告摘要。《美国医学会杂志》323, 1239-1242(2020)。

方,Y。et al。2019冠状病毒病(covid-19):对919例患者的影像学结果进行系统综述。放射学296, e115-e117(2020)。

穆罕默迪,一个。et al。基于机器学习和超信号处理的covid-19胸部图像诊断/预后:挑战、机遇和应用IEEE信号处理。玛格。38, 37 - 66。https://doi.org/10.1109/MSP.2021.3090674(2021)。

Salehi, S., Abedi, A., Balakrishnan, S. & Gholamrezanezhad, A.胸部ct对covid-19的敏感性:与rt-pcr的比较。点。j . Roentgenol。215, 87-93(2020)。

Rafiee, M., Babaki Fard, F., Samimi, K., Rasti, H. & Pressaco, J.自发性气胸和纵隔气肿是covid-19肺炎的罕见并发症:6例报告。Radiol。代表。16, 687-692(2021)。

Miglioretti D。et al。计算机断层扫描在儿科的应用及相关的辐射暴露和估计的癌症风险。JAMA Pediatr。167, 700-707(2013)。

Fearon, t . & Vucich, J.儿科患者ct检查暴露:Ge ct/t 9800扫描仪。学杂志144, 805-809(1985)。

皮尔斯,M。et al。儿童CT扫描的辐射暴露和随后的白血病和脑肿瘤风险:一项回顾性队列研究《柳叶刀》380, 499-505(2012)。

Bell, D. & Gerstmair, A.尽可能低(alara)。

Taekker, M., Kristjansdottir, B., Ole, G., Laursen, C. & Pietersen, P.低剂量和超低剂量ct在胸部病理诊断中的准确性:一项系统综述。中国。成像74, 139-148(2021)。

Sakane, H。et al。低剂量胸部CT对染色体dna的生物学影响。放射学295, 439-445(2020)。

公园,J。et al。低剂量CT扫描在急诊室疑似急性下呼吸道感染老年患者中的应用价值Br。j . Radiol。89, 20150654(2016)。

Schulze-Hagen, M。et al。低剂量胸部CT诊断covid-19——与PCR进行系统、前瞻性比较。Dtsch。Arztebl。Int。117, 389-395(2020)。

Dangis,。et al。低剂量亚毫西弗胸部CT诊断COVID-19的准确性和重复性Radiol。Cardiothorac成像2, e200196(2020)。

Tofighi, S, Najafi, S, Johnston, S. & Gholamrezanezhad, A. COVID-19暴发中的低剂量CT:辐射安全,图像明智,图像温柔承诺。紧急情况。Radiol。27, 601-605(2020)。

Ardila D。et al。基于三维深度学习的低剂量胸部计算机断层扫描肺癌端到端筛查。Nat,地中海。25, 954-961(2019)。

埃斯皮诺萨,J. L.和董丽婷。改进肺癌筛查的人工智能工具。j .中国。地中海。9, 3860(2020)。

期刊,我。et al。基于深度残余神经网络的covid-19患者超低剂量胸部ct成像欧元。Radiol。31, 1420-1431(2021)。

Sabour, S., Frosst, N. & Hinton, g.e.胶囊间的动态路由。第31届神经信息处理系统国际会议论文集3859 - 3869(2017)。

Afshar, P。et al。3d-mcn:用于肺结节恶性肿瘤预测的三维多尺度胶囊网络。科学。代表。10, 7948(2020)。

梅,X。et al。人工智能对covid-19患者进行快速诊断。Nat,地中海。26, 1224-1228(2020)。

Afshar, P。et al。COVID-CT-md, COVID-19计算机断层扫描数据集,适用于机器学习和深度学习。科学。数据8, 1(2021)。

McNemar检验法,Q。心理统计学(威利,1962)。

h神,M。et al。Co-rads:对疑似covid -19患者的分类CT评估方案。放射学296, e97-e104(2020)。

Altmayer, S。et al。免疫功能正常成人COVID-19和其他病毒性肺炎ct检查结果的比较:系统综述和荟萃分析欧元。Radiol。https://doi.org/10.1007/s00330-020-07018-x(2020)。

乔纳斯,D。et al。用低剂量计算机断层扫描筛查肺癌:美国预防服务工作组的最新证据报告和系统回顾。《美国医学会杂志》325, 971-987(2021)。

Armato, S。et al。肺图像数据库联盟(lidc)和图像数据库资源计划(idri):一个完整的ct扫描肺结节参考数据库。地中海,物理。38, 915-931(2011)。

金融、J。et al。低剂量胸部CT和肺部超声诊断和治疗COVID-19j .中国。地中海。10, 2196(2021)。

吴,E。et al。如何评估医疗人工智能设备:FDA批准分析的限制和建议。Nat,地中海。27, 576-584(2021)。

Kleppe,。et al。设计癌症诊断中的深度学习研究。Nat. Rev. Cancer21, 1999 - 211(2021)。

孙智,张楠,李勇,徐霞。新冠肺炎胸部影像学研究综述。定量、影像、医学、外科。10, 1058-1079(2020)。

Bwire, G.冠状病毒:为什么男性比女性更容易感染covid-19 ?SN压缩机。中国。地中海。2, 874 - 876。https://doi.org/10.1007/s42399-020-00341-w(2020)。

Francone, M。et al。COVID-19患者胸部CT评分与疾病严重程度和短期预后的相关性欧元。Radiol。30., 6808-6817(2020)。

委员会,D. S.,组,W.,试验,C.和文本,F.附录142:临床试验去识别概要。DICOM标准在美国(2011年)。

Pontana F。et al。使用迭代重建与过滤后投影的胸部计算机断层扫描(第1部分):32例患者图像降噪的评估。欧元。Radiol。21, 627-635(2011)。

Hofmanninger, J。et al。常规成像中的自动肺分割主要是一个数据多样性问题,而不是一个方法论问题。欧元。Radiol。经验值。4, 50(2020)。

Patrick, M., Adekoya, A., Mighty, A. & Edward, B.胶囊网络:调查。沙特国王大学。正,科学。34, 1295 - 1310。https://doi.org/10.1016/j.jksuci.2019.09.014(2022)。

Jeong, Y, Lee, Y. & Kim, H. Ladder胶囊网络。第36届国际机器学习会议论文集97, 3071-3079(2019)。

塞尔瓦拉朱,r.r.。et al。梯度凸轮:通过基于梯度的定位,来自深度网络的视觉解释。IEEE计算机视觉国际会议论文集(2017)。

Nilashi, M, Ibrahim, O. & Ahani, A.预测帕金森病进展的准确性提高。科学。代表。6, 1(2016)。

确认

这项工作得到了加拿大自然科学与工程研究委员会(NSERC)通过RGPIN-2016-04988的部分支持。

作者信息

作者及隶属关系

贡献

P.A.和S.H.实现了AI模型。p.a., M.J.R和A.M.起草了手稿。M.J.R.收集了数据集,是第一个为患者标记的放射科医生。A.O.和F.B.F.是另外两个标记数据集的放射科医生。R.A.是第四位与AI模型进行比较的放射科医生。F.N.和N.E.进行统计分析。K.N.P.和K.F.监督了模型的验证。A.M.监督了这项研究。所有作者都修改了手稿。

相应的作者

道德声明

相互竞争的利益

作者声明没有利益竞争。

额外的信息

出版商的注意

施普林格自然对出版的地图和机构从属关系中的管辖权主张保持中立。

权利和权限

开放获取本文遵循知识共享署名4.0国际许可协议,允许以任何媒介或格式使用、分享、改编、分发和复制,只要您对原作者和来源给予适当的署名,提供知识共享许可协议的链接,并注明是否有更改。本文中的图像或其他第三方材料包含在文章的创作共用许可协议中,除非在材料的信用额度中另有说明。如果材料未包含在文章的创作共用许可协议中,并且您的预期使用不被法定法规所允许或超出了允许的使用范围,您将需要直接获得版权所有者的许可。如欲查看本牌照的副本,请浏览http://creativecommons.org/licenses/by/4.0/.

关于本文

引用本文

阿夫沙尔,P.,拉菲,M.J.,纳德卡尼,F.。et al。使用两阶段时间分布胶囊网络,从低剂量CT扫描中诊断人类COVID-19。Sci代表12, 4827(2022)。https://doi.org/10.1038/s41598-022-08796-8

收到了:

接受:

发表:

DOI:https://doi.org/10.1038/s41598-022-08796-8